说明

底本为 Language Models Interview Handbook(© 2026 Lamhot Siagian, AI Engineering Insider);个人学习整理,转载请注明出处,勿用于商业再发行。

第 13 章 微调、PEFT 与适配策略

本章概述

基础模型起点宽,但生产系统常需要更窄的行为:更好的指令遵循、领域适配、更低延迟,或更稳定的输出。微调是路径之一,但它处在一个谱系上:包括监督微调、指令微调、偏好优化,以及 LoRA 等参数高效适配(Ouyang et al., 2022; Hu et al., 2021)。

最强的面试回答会区分微调能修什么与不能修什么。微调在行为塑造与专门化上很强,但替代不了检索质量、评估纪律或产品级控制。

Interview Anchor 面试锚点

| 维度 | 内容 |

|---|---|

| 面试官真正想测的 | 能否用预算意识的工程视角比较提示工程、PEFT、LoRA、QLoRA与全量微调。 |

| 高质量回答套路 | 从要补齐的行为缺口出发,再谈适配强度、数据质量、算力成本、可迁移性与运维风险。 |

| 常见低分答法 | 把 LoRA 或 QLoRA 说成普适最优。它们是强折中,不是万能答案。 |

INTERVIEW CHEATSHEET 面试速记条

| 项 | 要点 |

|---|---|

| 要表达的亮点 | 适配策略应匹配行为缺口、算力预算、延迟目标与部署灵活性。 |

| 最佳举例 | 先改进提示与检索,再在需要持久行为改变且成本适中时用 PEFT。 |

| 可追问方向 | 提到灾难性遗忘、评估集与回滚策略。 |

| 资深补充 | 讨论部署与治理,不止训练机理。 |

| 切忌这样说 | 在证明问题不是检索或提示设计之前就全量微调。 |

适配选择表帮助把「提示 vs PEFT vs 全量微调」的边界答成原则决策,而不是个人偏好。

表 13.1:在提示改动、PEFT 与全量微调之间做选择

| 选项 | 最适用 | 取舍 |

|---|---|---|

| 提示与检索更新 | 行为缺口主要在指令或证据 | 最快、最安全,但对更深层的风格或策略适配有限 |

| LoRA | 需要持久行为改变且算力可承受 | 对许多企业场景是质量与效率的较好平衡 |

| QLoRA | 硬件紧张、内存是瓶颈 | 适合实验,但仍需严谨评估 |

| 全量微调 | 任务关键且适配必须很深 | 成本与运维复杂度最高 |

Listing 13.1(书中摘录):面试里常讨论的 PEFT 配置片段——锚定 adapter、rank、alpha、目标模块 等术语。

1 | from peft import LoraConfig |

What Strong Candidates Sound Like

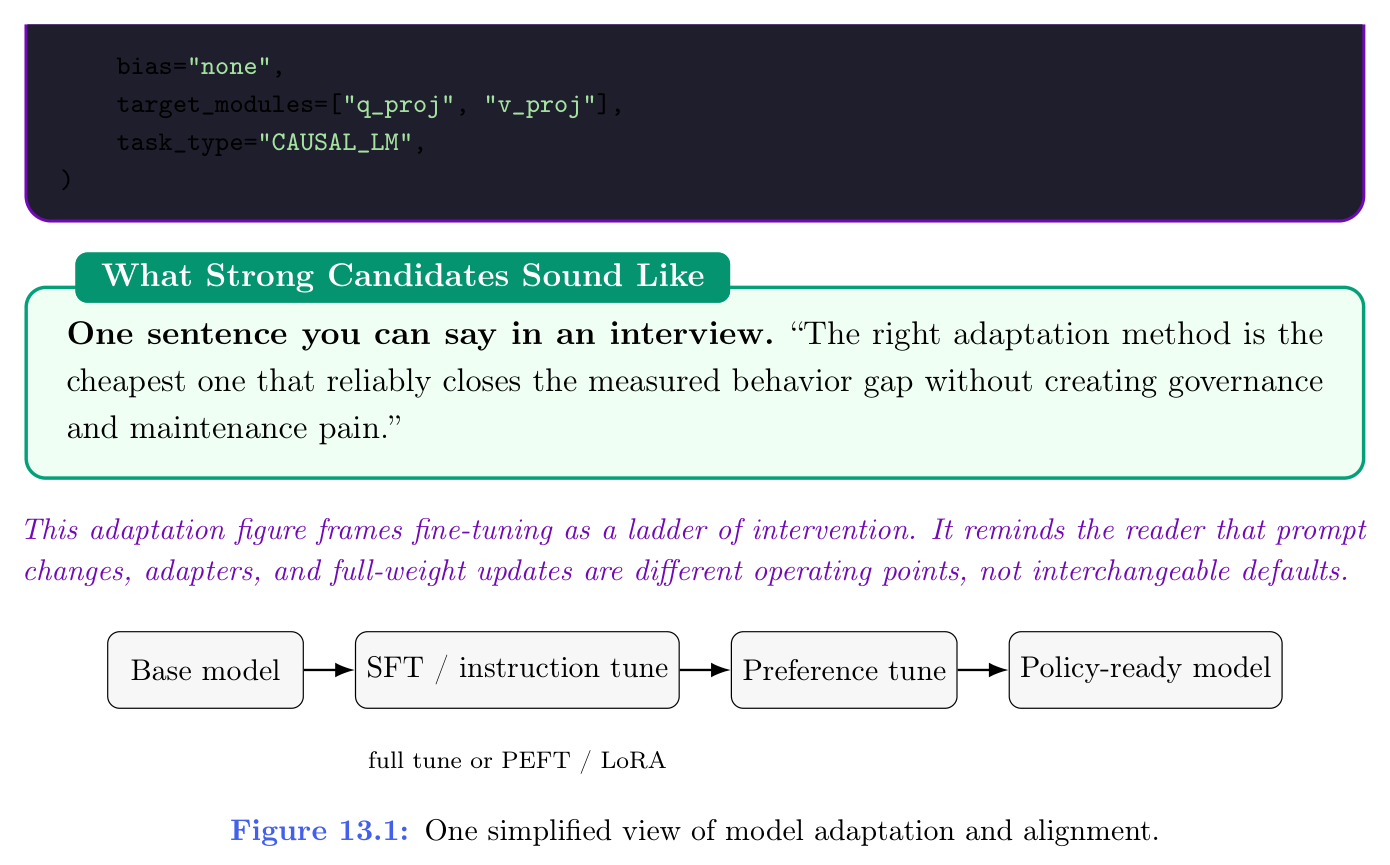

书里有一句可背的口述(译文):「正确的适配方法是最便宜、能可靠关闭已度量的行为缺口、且不制造治理与维护痛苦的那一种。」

图 13.1:模型适配与对齐的简化阶梯(基座模型 → SFT/指令微调 → 偏好微调 → 可上线策略模型;全调或 PEFT/LoRA 标注在途中)。

表 13.2:实务中的适配策略

| 方法 | 最擅长 | 主要取舍 |

|---|---|---|

| 提示 | 快速迭代与多变任务 | 难任务上一致性较弱 |

| 检索 | 知识锚定与新鲜度 | 质量取决于证据选择 |

| LoRA / PEFT | 高效的领域或任务适配 | 仍要数据、评估与模型治理 |

| 全量微调 | 最大专门化 | 算力与维护成本最高 |

问答(Q111–Q121)

Q111. 全量微调与参数高效微调有何区别?

答。全量微调更新全部或大部分权重,可带来强适配,但在算力、内存与部署复杂度上昂贵。参数高效方法只更新一小部分参数或增加轻量可训模块,使适配便宜得多。

面试中要说:PEFT 在你需要许多任务变体、更快迭代或更低服务开销时很吸引人;全量微调在需要最大任务适配且资源允许时仍有价值。

Q112. 什么是 LoRA 与 QLoRA?二者如何不同?

答。LoRA(低秩适配)冻结基座模型,学习小的低秩矩阵以高效修改选定的 Transformer 权重。QLoRA在相同适配思路上,把冻结的基座以低比特量化,从而在有限内存下也能微调大得多的模型。

实务区别:LoRA重在减少可训参数;QLoRA还显著压低训练期内存占用——因此在普通硬件上适配大型开放模型时非常有用(Hu et al., 2021; Dettmers et al., 2023)。

Listing 13.2(书中摘录):带 LoRA 适配器的最小 PEFT 工作流示例。

1 | from transformers import AutoModelForCausalLM |

Q113. 监督微调、指令微调与偏好优化有何区别?

答。监督微调用输入—输出对教模型。指令微调是其特化:任务以自然语言指令呈现,使模型更擅长跨任务听从请求。偏好优化用排序或成对反馈把模型推向人类更偏好的输出。

强回答是:这些方法塑造不同侧面的行为。SFT 教任务模式;指令微调拓宽可用性;偏好方法在纯模仿之外改善有用性、安全性或风格(Ouyang et al., 2022)。

Q114. 什么是模型蒸馏?何时有用?

答。模型蒸馏训练较小的学生模仿较大的教师,常通过学习教师的软概率分布而非仅有硬标签。目标是在降低延迟、内存与部署成本的同时,尽量保留教师行为。

蒸馏在约束不只是准确率还包括效率时有用——在移动、边缘或高吞吐场景,前沿模型直接服务太贵。面试中要区分蒸馏与 PEFT:蒸馏产出新的更小模型;PEFT更便宜地适配现有大模型(Hinton et al., 2015)。

Q115. 何时微调才真正值得投入?

答。当提示与检索已触顶、任务稳定、有标注数据,且业务上奖励更高一致性或更低单次请求成本时,微调值得。同一行为需大规模重复时尤其有说服力。

面试中要克制:弱提示后的下一步不一定是微调——真问题有时是数据差、切块糟或缺工具。

Q116. 什么使微调数据集「高质量」?

答。高质量数据清晰、有代表性、标注正确、在边界案例上多样,并与生产中要的确切行为对齐。小而干净的数据集常胜大而嘈杂——模型也会忠实地学你的不一致。

最佳面试回答是:数据质量决定上限。微调放大数据中的模式;它不会发明比你给的更好目标。

Q117. 什么是灾难性遗忘?为何重要?

答。灾难性遗忘指微调把模型强烈推向新领域或任务,以致丧失先前有用的通用能力。当产品仍依赖广域推理、风格跨度或微调样例之外的知识时,这就成问题。

面试中应提缓解:平衡数据混合、更轻的适配方法,以及在新能力与保留能力上同时评估。好的专门化不应无谓摧毁通用能力。

Q118. 发布前应如何评估微调后的模型?

答。同时评估目标任务收益与意外回退:任务准确率、安全行为、格式稳定性、拒绝正确性、延迟,以及对真实提示而非仅训练式样本的泛化。

成熟回答是:应把微调模型与基座以及最便宜的不微调方案对比——否则无法判断微调是否对得起复杂度。

Q119. 对齐与微调是什么关系?

答。对齐指塑造模型,使其行为更贴合人类意图、安全要求与产品策略。微调是对齐机制之一,但对齐也依赖偏好数据、护栏、工具、检索约束与评估方法。

面试中解释:对齐宽于礼貌或拒绝——它是在真实应用中把模型导向有用、合适且符合策略的行为。

Q120. 微调项目的主要成本权衡是什么?

答。主要成本包括数据制作、训练算力、评估投入、模型存储、服务复杂度,以及跨版本的运维维护。只有微调在质量、速度或单次成本上相对「只提示」带来可度量增益时,这些成本才站得住脚。

强回答是:微调既有前期也有生命周期成本——团队有时盯着训练成本,却忽略长期管理多个适配模型的负担。

Q121. 团队何时应完全避免微调?

答。当任务快速变化、数据集薄弱、行为主要是知识检索而非技能适配,或产品能用更好的提示、检索或工具解决时,应避免微调。微调可能增加复杂度却解决不了真正瓶颈。

面试中这体现纪律:好工程师不优化错误的那一层栈。