说明

底本为 Language Models Interview Handbook(© 2026 Lamhot Siagian, AI Engineering Insider);个人学习整理,转载请注明出处,勿用于商业再发行。

第 11 章 多模态大语言模型

本章概述

多模态模型把语言界面扩展到文本之外,把图像、音频、视频或其它模态纳入同一推理循环。技术难点不仅是编码各模态,还要对齐它们的表示,使系统能把语言锚定在非文本证据上。CLIP 展示了图文对齐如何支撑强零样本迁移;后来的多模态指令微调系统则进一步推向对话式交互(Radford et al., 2021; Liu et al., 2023)。

面试官常用多模态问题观察候选人能否把 LLM 直觉迁移到更广的系统场景——在那里感知、锚定与评估都更复杂。

Interview Anchor 面试锚点

| 维度 | 内容 |

|---|---|

| 面试官真正想测的 | 能否解释多模态系统如何把图像或其它信号与语言对齐,而不堆空话。 |

| 高质量回答套路 | 描述模态专用编码器、对齐到共享表示空间,以及语言侧在融合信号上的推理。 |

| 常见低分答法 | 暗示图像只是「变成文本」。应讲表示对齐与局限。 |

INTERVIEW CHEATSHEET 面试速记条

| 项 | 要点 |

|---|---|

| 要表达的亮点 | 多模态系统对齐不同数据类型,使语言推理能操作不止文本。 |

| 最佳举例 | 图像理解常见做法是视觉编码器 + 语言模型,而不是单一黑盒。 |

| 可追问方向 | 提到对齐、指令微调,以及在感知与推理任务上的评估。 |

| 资深补充 | 区分感知错误与下游推理错误。 |

| 切忌这样说 | 假定多模态质量用与纯文本完全相同的方式评估即可。 |

What Strong Candidates Sound Like

书里有一句可背的口述(译文):「多模态模型只有表示对齐与推理都可靠才算成功——因为感知错误会传导到每一个下游语言答案。」

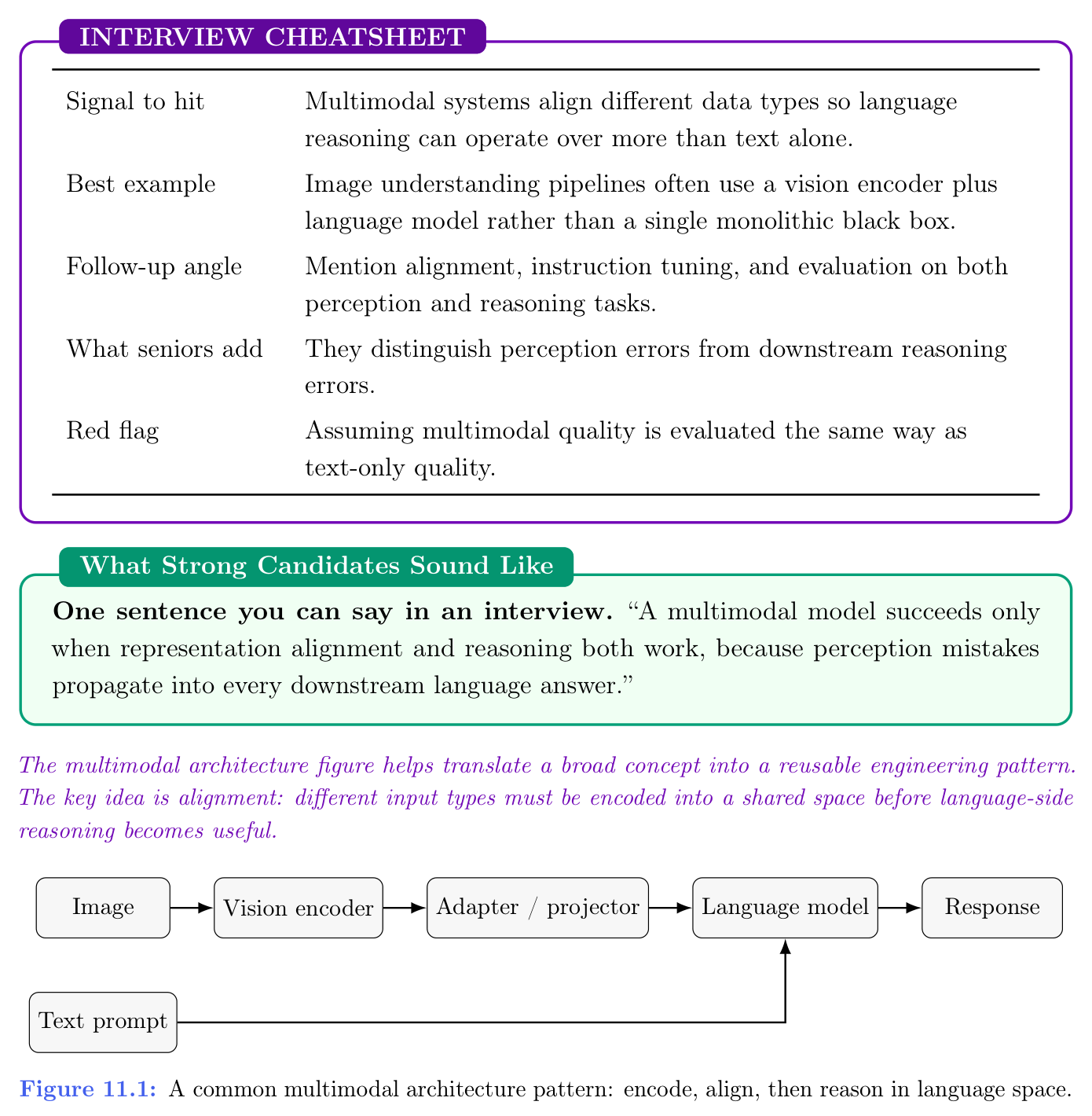

多模态架构图把宽泛概念落成可复用的工程模式:对齐是关键——不同输入类型必须先编码进共享空间,语言侧推理才有用。

图 11.1:一种常见模式:编码 → 对齐 → 在语言空间中推理。(图内元素:图像 → 视觉编码器 → 适配器/投影 → 语言模型 → 回复;另有文本提示支路。)

问答(Q91–Q100)

Q91. 什么是多模态 LLM?

答。多模态 LLM 是能处理并推理一种以上输入或输出模态的系统,例如文本+图像或文本+音频。语言模型通常仍是中心,但通过额外编码器或适配器把非文本输入转成模型可用的表示。

强回答会指出:多模态不只是加图像——而是跨模态对齐表示,使系统能回答有据问题,而非单靠文本先验胡编。

Q92. 文本—图像系统背后常见的架构模式是什么?

答。常见模式是视觉编码器把图像变成嵌入,再通过投影或适配器映射到语言模型能消费的空间;LLM 在生成时同时以文本 token与图像派生表示为条件。

面试关键是讲清桥梁:语言模型并不是在读像素;另一个模型把像素变成 LLM 能推理的形式。

Q93. 为何 CLIP 在多模态系统史中很重要?

答。CLIP 表明图像与文本表示可以通过大规模配对数据上的对比学习对齐。这使零样本视觉任务更可行,并展示了把自然语言作为感知模型监督信号的力量。

其重要性概念与实证并重:它帮助确立了对齐表示空间可支撑灵活的多模态推理与检索,而非狭隘的固定标签视觉系统(Radford et al., 2021)。

Q94. 多模态模型中的「视觉锚定(visual grounding)」指什么?

答。视觉锚定指模型的语言输出真正系在图像证据上,而非来自语言先验或刻板假设。对图表、小票或照片的有据回答应反映图像中实际存在的内容,而不只是一般意义上说得通的话。

面试中要说:锚定是多模态 AI 的核心信任问题——没有锚定的流利会产生非常可信的错误。

Q95. 何时应依赖 OCR,何时依赖原生视觉—语言理解?

答。当图像主要是文字(文档、表单、小票、截图)时,OCR 常常有用。当空间布局、物体、关系与混合视觉—文本线索共同重要时,原生多模态模型更有价值。

实务答案是选最匹配信息源的工具。许多强系统同时结合 OCR 与多模态推理,而非二选一。

Q96. 多模态提示与纯文本提示有何不同?

答。多模态提示不仅要指示答什么,还要引导模型查哪段视觉证据。好提示常指明任务、所需细节程度,以及是否优先图像内文字、物体关系、布局或视觉异常。

原则仍是清晰任务胜过模糊请求;但多模态提示还需意识到感知极限、图像质量,以及某些细节根本看不见的可能。

Q97. 如何评估多模态系统?

答。评估应衡量有据正确性,而不只是流利度。视任务可能包括:答案准确率、物体或属性正确性、OCR 保真度、空间推理表现、图像不清晰时的拒绝行为,以及人工对有用性的偏好。

面试中要说:多模态评估通常需要任务专用数据集 + 人工审查——许多失效很微妙,无法单靠字符串匹配发现。

Q98. 多模态 LLM 有哪些常见失效模式?

答。常见失效包括:虚构未见物体、误读小字、丢失空间关系、搞混图表、过度信任嘈杂 OCR、以及在图像实际支撑之外作答。分布偏移也很严重——真实图像与精选基准差别大。

资深补充:多模态失效格外危险,因为用户可能假设「模型看了图就一定知道」。锚定与弃权在这里更重要。

Q99. 音频与视频相比静态图像,设计上如何改变?

答。音频与视频引入时间,系统必须建模帧序列或声学特征序列及其与语言的关系。这提高算力成本,并带来额外对齐问题——例如视频中哪一刻支持该答案。

面试中要体现出系统后果:时序模态需要采样、分段、同步,以及常需要分层推理,而非单次编码。

Q100. 哪些多模态用例通常最先带来较好业务价值?

答。早期价值往往在锚定清晰、工作流可度量的场景:文档理解、截图支持、视觉质检、图表解释、在人工监督下的医学影像辅助,以及无障碍相关的图像描述。

强面试回答聚焦多模态带来非平凡证据的用例,而不是为新奇而加图像。业务价值来自文本单独不够之处的有据感知。