说明

底本为 Language Models Interview Handbook(© 2026 Lamhot Siagian, AI Engineering Insider);个人学习整理,转载请注明出处,勿用于商业再发行。

第 4 章 Transformer 架构、注意力与位置推理

本章概述

Transformer 是现代大语言模型的架构主干。其核心洞见是:序列建模可以围绕注意力而非递归来构建,从而在仍能建模长程依赖的前提下,让训练并行化。这一改变重塑了 NLP,并进一步影响了多模态、视觉与语音等系统(Vaswani et al., 2017)。

理解 Transformer,意味着理解 token 表示如何通过自注意力、前馈块、残差连接与位置信息被混合。面试里常会考察候选人能否在多个层次上解释该架构:直观、数学与系统视角。

Interview Anchor 面试锚点

| 维度 | 内容 |

|---|---|

| 面试官真正想测的 | 能否把注意力讲得足够清楚,让团队相信你能推理模型行为、上下文混合与规模化权衡。 |

| 高质量回答套路 | 先把自注意力说成带权的信息路由,再连到并行序列处理、长程依赖与位置编码。 |

| 常见低分答法 | 用玄学措辞,例如「模型一下子什么都懂了」。应讲清机制,再谈工程后果。 |

INTERVIEW CHEATSHEET 面试速记条

| 项 | 要点 |

|---|---|

| 要表达的亮点 | 注意力让每个 token 通过动态加权其它 token,构建依赖上下文的表示。 |

| 最佳举例 | 代词或否定是否成立,往往取决于若干位置之前的 token。 |

| 可追问方向 | 提到多头注意力、位置编码,以及序列长度如何影响显存与算力。 |

| 资深补充 | 把注意力既当作建模概念,也当作系统瓶颈来讲。 |

| 切忌这样说 | 把注意力权重与完全可解释性混为一谈,或默认把它们当成因果解释。 |

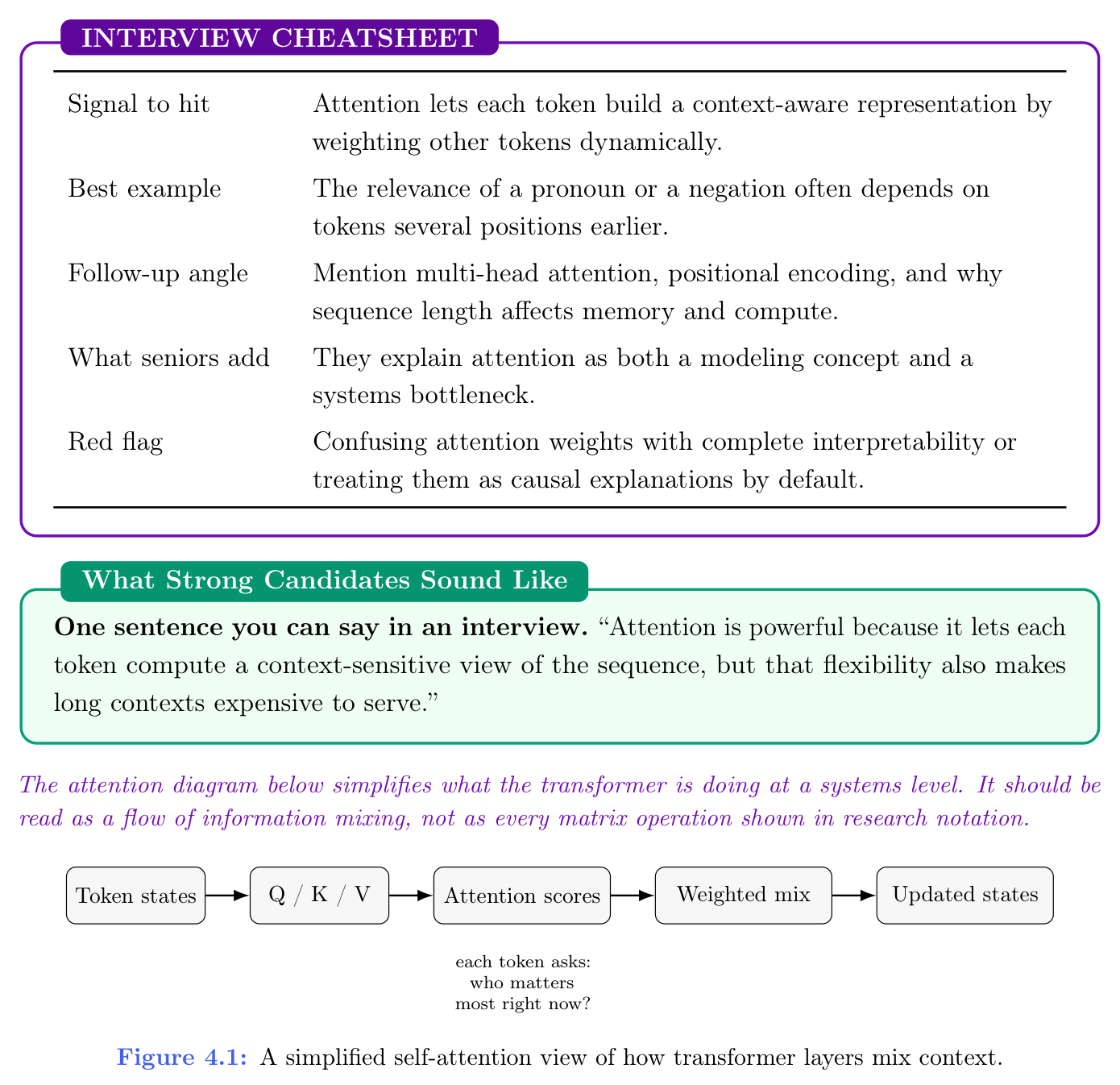

下面的注意力示意图从系统层面简化了 Transformer 在做什么。应把它读作信息流混合,而不是研究记号里的每一个矩阵运算都画全。

图 4.1(A simplified self-attention view of how transformer layers mix context.):

流程要点(与图一致):Token 状态 → Q/K/V → 注意力分数(每个 token 在问:此刻谁最重要?)→ 加权混合 → 更新后的状态。

What Strong Candidates Sound Like

书里有一句可背的口述(译文):「注意力强大,在于它让每个 token 都能计算序列的上下文敏感视图;但这种灵活性也让长上下文在服务侧变得昂贵。」

问答(沿用书中编号 Q21–Q30)

Q21. 为什么 Transformer 算得上一场重大突破?

答。 在 Transformer 之前,许多序列模型依赖递归,按时间步逐个处理 token。这既拖慢训练,也让长程依赖更难追踪。Transformer 用注意力取代递归,使每个 token 能直接对序列中其它相关 token 加权,同时极大提升可并行计算量。

因此突破既是算法上的,也是工程上的:它同时增强了建模能力与在现代加速器上的硬件利用率。面试里不要只答「因为注意力」。应说明该架构更易规模化、在当代硬件上训练更快,并泛化为当今 LLM 的基础骨架(Vaswani et al., 2017)。

Q22. 用简单话说,什么是自注意力(self-attention)?

答。 自注意力是一种机制:序列里每个 token 都能「看」同一序列中的其它 token,并决定哪些对构建自己的表示最重要。表示「bank」的 token 可以关注附近的「river」或「loan」,从而相应调整语义。

一个好用的心智模型是:每个 token 都在问——「在更新自己的理解之前,我该参考哪些其它 token?」因此自注意力对消歧、共指与远距离依赖特别强。面试里清晰胜过行话:说明注意力是在构建依赖上下文的含义。

Q23. 在注意力里,Query、Key、Value 向量各起什么作用?

答。 Query(查询)表示当前 token 在找什么。Key(键)表示每个 token 作为可被寻址信号提供什么。Value(值)则是在相关性确定之后,实际被混合进去的内容。注意力分数来自 Query 与 Key 的匹配;值的加权和成为新的表示。

实务上:Query–Key 相似度决定「谁重要」,Value决定「把什么信息拷贝/汇总到下一步」。面试官喜欢这题,因为它区分你是真懂注意力,还是只背了名词。最好的回答既讲匹配步骤,也讲内容聚合步骤。

Q24. Transformer 为什么要用多头注意力(multi-head attention)?

答。 多个头让模型能并行学习多种关系。某一头可能偏重局部句法,另一头偏重实体指代,再一头偏重篇章结构,还有一头偏重位置模式。每个头有各自的投影空间,模型不必被压进单一的「相关性」定义里。

关键是分工/专精。多头注意力在不必用一个巨型注意力模式包办一切的前提下,提高了表示丰富度。面试里避免说「头越多越好」。更多头带来更大灵活性,但其价值取决于模型规模、任务与训练质量。

Q25. Transformer 为什么需要位置编码(positional encodings)或位置嵌入(positional embeddings)?

答。 仅靠注意力本身,模型对输入是置换不变的:拿掉位置信息后,模型知道有哪些 token,却不知道它们出现的顺序。位置编码注入序列顺序,才能区分「dog bites man」与「man bites dog」。

现代系统采用不同位置策略,包括可学习嵌入与旋转位置嵌入(RoPE)等。面试里最稳妥的答法是:必须加入位置信号,因为单靠注意力并不编码顺序;没有它们,语言最核心的结构之一会丢失(Su et al., 2021)。

Q26. 仅编码器、仅解码器与编码器–解码器 Transformer 有何区别?

答。 仅编码器模型面向理解类任务(如分类、检索)优化,因为可以对输入做双向注意力。仅解码器模型按自回归方式生成文本:由已有 token 预测下一个 token。编码器–解码器把输入编码与输出生成分开,常见于翻译与序列到序列任务。

面试里好的回答会把架构映射到工作负载:BERT 偏编码器风格,GPT 系是仅解码器,T5 是编码器–解码器。重点不只是分类,而是注意力模式如何改变模型最擅长的事(Devlin et al., 2019; Raffel et al., 2020)。

Q27. 前馈块、残差路径与层归一化各贡献什么?

答。 自注意力在 token 之间混合信息;而逐位置前馈网络在那之后对每个 token 的表示做非线性变换。残差连接保留梯度通路、帮助深层网络稳定——让每个块学的是修正而不是整段替换。层归一化通过把激活保持在可控范围,改善训练稳定性。

强回答会强调:Transformer 不只是注意力;它是注意力加上重复的稳定化与变换机制。面试官常借此看你是否理解:架构为何以堆叠方式有效,而不仅是一个巧妙的注意力技巧。

Q28. 为什么 Transformer 易规模化,但在长序列上又变贵?

答。 Transformer 易扩展,是因为注意力可以跨 token 并行计算,很贴合现代硬件。但标准自注意力让 token 两两比较,因此序列长度增加时,计算与显存增长很快。

所以长上下文不是免费午餐:工程师要在延迟、吞吐与显存压力上付出代价。面试里要把架构连到系统:正是同一套设计既让 Transformer 占主导,也强烈推动了上下文优化、稀疏注意力思路、批处理策略与 KV 缓存等工程手段。

Q29. 因果掩码(causal masking)与双向注意力有何不同?

答。 因果掩码阻止某个 token 关注未来 token,这对自回归下一 token 预测必不可少。双向注意力允许 token 同时使用左侧与右侧上下文,适用于掩码语言建模、分类等理解任务。

更深层的一点是:掩码定义信息流。改变注意力掩码,就改变训练与推理时模型被允许知道什么。因此架构与训练目标在 Transformer 设计里是紧耦合的。

Q30. 工程师应了解哪些常见的 Transformer 失效模式?

答。 常见失效包括:长上下文上的注意力弥散、位置信息退化、嘈杂提示导致的上下文稀释、检索弱时的幻觉,以及解码配置不佳时的输出不稳定。这些并不意味着 Transformer「坏了」,而是说明外围系统必须妥善管理其局限。

面试里这是资深候选人拉开差距之处:不要停在架构图。要说明 Transformer 行为如何与 token 预算、检索质量、训练数据与服务约束相互作用——这才体现系统级理解,而不只是模型冷知识。